TL;DR

- Mitarbeitende in ganz Europa nutzen KI-Tools täglich, oft ohne offizielle Erlaubnis.

- McKinsey zeigt: C-Suite-Führungskräfte unterschätzen die tatsächliche KI-Nutzung um den Faktor 3. Sie schätzen, dass 4 % ihrer Mitarbeitenden KI intensiv nutzen. Tatsächlich sind es 13 %.

- Die Hauptgründe für Skepsis: Angst vor Fehlern der KI, regulatorische Unsicherheit durch den EU AI Act, Kontrollverlust und fehlendes Vertrauen.

- Das größte Risiko für Unternehmen ist nicht zu viel KI, sondern der Widerspruch zwischen informeller Nutzung und fehlender Governance.

- Wer jetzt handelt, gewinnt Vorsprung. Wer weiter wartet, riskiert unkontrollierte Nutzung ohne Schutz.

Das Büro arbeitet längst mit KI. Der Chef weiß es nicht

Irgendwo in einem Büro in München, Rotterdam oder Wien schreibt gerade jemand einen Bericht mit Hilfe von ChatGPT. Die Zusammenfassung für das nächste Meeting? KI. Die erste Version des Kundenbriefs? KI. Das sind keine Ausreißer mehr. Das ist Alltag. Und dennoch sitzt im Konferenzraum darüber eine Führungsriege und diskutiert, ob man dieses KI-Thema angehen sollte.

Diese Gleichzeitigkeit ist das Seltsame unserer Gegenwart: Die Technologie ist bereits mitten im Unternehmen, und trotzdem wird sie noch immer behandelt, als wäre sie eine Frage der Zukunft. Was also hält Entscheider zurück? Nicht Dummheit. Nicht Technikfeindlichkeit. Es ist etwas Kompliziertes. Und es lohnt sich, genau hinzuschauen.

Im Januar 2025 veröffentlichte McKinsey eine der bislang ehrlichsten Studien über KI am Arbeitsplatz. Befragt wurden über 3.600 Mitarbeitende und 238 Führungskräfte. Was dabei herauskam, ist ernüchternd, nicht wegen der Zahlen an sich, sondern wegen der Lücke zwischen ihnen.

C-Suite-Führungskräfte schätzen, dass 4 % ihrer Mitarbeitenden KI für mehr als 30 % ihrer täglichen Arbeit nutzen. Die Realität: 13 % tun es bereits. Das ist das Dreifache der Schätzung. Führungskräfte navigieren in einem Nebel. Sie glauben, wenig KI im Haus zu haben, und treffen Entscheidungen auf dieser falschen Grundlage.

„Das größte Hindernis für KI-Skalierung sind nicht die Mitarbeitenden, die sind bereit. Es sind die Führungskräfte, die nicht schnell genug steuern.“

Laut KPMG-Studie 2025, die 48.000 Menschen in 47 Ländern befragte, nutzen 50 % der Beschäftigten KI-Tools bei der Arbeit, ohne zu wissen, ob das überhaupt erlaubt ist. 44 % tun es wissentlich gegen interne Richtlinien. 53 % geben KI-generierte Inhalte als ihre eigenen aus. 58 % verlassen sich auf KI-Ergebnisse, ohne sie zu prüfen. Das ist kein Vorwurf an die Mitarbeitenden. Das ist das Ergebnis eines Vakuums.

Zum Vergleich einige weitere Zahlen aus aktuellen Studien:

- 78 % der Unternehmen weltweit nutzen KI in mindestens einer Geschäftsfunktion (Stanford AI Index 2025).

- 92 % der Unternehmen planen, ihre KI-Investitionen in den nächsten drei Jahren zu erhöhen (McKinsey 2025).

- Trotzdem sehen nur 1 % der Unternehmen ihre KI-Implementierung als wirklich reif an (McKinsey 2025).

Fünf echte Gründe, warum Entscheider zögern

Die Skepsis der Führungsetagen ist real. Sie ist manchmal übertrieben, manchmal berechtigt, und fast immer aus einem echten Erfahrungskontext heraus entstanden. Hier sind die fünf häufigsten Muster, die sich aus aktuellen Studien und europäischen Praxisbeispielen herausschälen.

Erstens: Die Genauigkeitsfrage

Das ist die ehrlichste aller Ängste. KI-Systeme halluzinieren. Sie produzieren selbstsicher klingende Antworten, die schlicht falsch sind. Für einen Mitarbeitenden, der einen Entwurf schreibt, ist das ärgerlich. Für ein Unternehmen, das einen Chatbot nach außen stellt, der Kunden falsche Auskünfte gibt, kann es teuer werden. McKinsey berichtet, dass 51 % der Unternehmen bereits mindestens eine negative Konsequenz durch KI-Einsatz erlebt haben. Ungenauigkeit ist mit 30 % das häufigste Problem. Das ist kein seltener Ausreißer. Das ist ein normales Betriebsrisiko.

Ein konkretes Beispiel aus Deutschland: Die Bundesfinanzverwaltung plant einen KI-Chatbot für häufige Anfragen. Das System ist so konzipiert, dass es bei komplexen Fällen automatisch an menschliche Sachbearbeiter weiterleitet. Dieses Hybrid-Modell zeigt, wie vorsichtige Implementierung aussieht: klar definierter Anwendungsbereich, begrenzte Autonomie. (Quelle: EU AI Watch, Germany Strategy Report)

Zweitens: Regulatorische Unsicherheit durch den EU AI Act

Europa hat mit dem EU AI Act das weltweit erste umfassende KI-Regelwerk geschaffen. Der Act ist seit August 2024 in Kraft, die vollständige Anwendung erfolgt schrittweise bis August 2026. Hochrisiko-Anwendungen wie KI in der Personalentscheidung oder Kreditvergabe unterliegen strengen Transparenz- und Dokumentationspflichten. Für mittelständische Betriebe ohne eigene Legal-Abteilung für KI-Compliance ist das ein echter Grund zur Vorsicht.

Dazu kommt die DSGVO. Im November 2025 veröffentlichte die Datenschutzkonferenz in Deutschland erstmals Leitlinien zu datenschutzrechtlichen Fragen bei internen Chatbots. Das ist ein Zeichen dafür, dass selbst die Aufsichtsbehörden noch dabei sind, die Regeln zu formulieren. Entscheider, die auf Klarheit warten, warten nicht aus Bequemlichkeit.

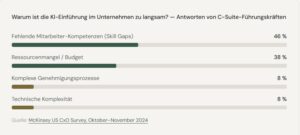

McKinsey hat die wichtigsten Gründe für eine zu langsame KI-Einführung erfragt. Die Antworten der befragten C-Suite-Führungskräfte: Fehlende Mitarbeiterkompetenzen (46 %), Ressourcenmangel und Budget (38 %), komplexe Genehmigungsprozesse (8 %) und technische Komplexität (8 %). Auffällig ist, dass regulatorische Hürden in dieser Befragung nicht explizit als Haupthindernis genannt werden, was darauf hindeutet, dass viele Unternehmen die regulatorischen Anforderungen noch nicht vollständig einschätzen können. (Quelle: McKinsey US CxO Survey, Oktober bis November 2024)

Drittens: Kontrollverlust und Haftungsfragen

Hinter vielen Einführungsstopps steckt eine sehr menschliche Frage: Wer ist verantwortlich, wenn etwas schiefgeht? EY befragte 2025 975 C-Suite-Führungskräfte in 21 Ländern. Das Ergebnis: Nur 18 % der CEOs gaben an, dass ihr Unternehmen starke Kontrollen für KI-Fairness und Bias hat. Nur 14 % glauben, dass ihre KI-Systeme regulatorisch konform betrieben werden. Das ist kein Zeichen von Gleichgültigkeit. Das ist das Bewusstsein, in unbekanntem Terrain zu navigieren.

„Etwa die Hälfte der Führungskräfte gibt zu, dass es schwierig ist, Governance-Rahmen für aktuelle KI-Technologien zu entwickeln und dass ihre Rahmen für die nächste Generation noch nicht bereit sind.“

Viertens: Das Vertrauensproblem innerhalb des Unternehmens

KI-Einführungen scheitern nicht nur an Technik oder Regulierung. Sie scheitern daran, dass verschiedene Gruppen im Unternehmen unterschiedliche Ängste, Hoffnungen und Motivationen mitbringen. PwC’s Global Workforce Hopes and Fears Survey 2025 zeigt: Nur 53 % der Frontline-Mitarbeitenden vertrauen darauf, dass ihre Führungskräfte KI verantwortungsvoll einführen werden. Bei Senior-Führungskräften selbst sind es 71 %. Eine Lücke von 18 Prozentpunkten.

Und noch eine Zahl, die nachdenklich macht: Nur 46 % der Mitarbeitenden vertrauen KI-Systemen am Arbeitsplatz, obwohl zwei Drittel sie regelmäßig nutzen. (Quelle: Azumo AI in the Workplace Statistics 2026) Das ist das eigentliche Paradox: Menschen benutzen Werkzeuge, denen sie nicht vollständig vertrauen. Und Führungskräfte wollen keine Tools einführen, deren Akzeptanz sie nicht kennen.

Fünftens: Das Messbarkeitsproblem

Investitionen brauchen Rechtfertigungen. Und KI ist berüchtigt dafür, im Pilotprojekt gut auszusehen und in der Skalierung zu enttäuschen. Laut verschiedenen Studien scheitern 70 bis 85 % der KI-Projekte daran, echten Geschäftswert zu liefern. Dabei sind 70 % der Hindernisse Menschen- und Prozessprobleme, keine technischen. Nur 19 % der Unternehmen berichten von einer Umsatzsteigerung über 5 % durch generative KI. 36 % sehen gar keine Umsatzveränderung. Gleichzeitig erwarten 87 % der Führungskräfte Wachstum durch KI, allerdings erst in drei Jahren. Diese Lücke zwischen Erwartung und aktueller Realität macht Entscheider vorsichtig.

Was in Europa anders ist

Europa ist kein homogener Raum. Die KI-Skepsis von Führungskräften in Deutschland hat andere Wurzeln als die in Estland oder Spanien. Aber es gibt gemeinsame Muster. Deutschland ist gemeinsam mit den Niederlanden und Italien eines der Länder mit den meisten dokumentierten KI-Einsatzfällen im öffentlichen Sektor in Europa. (Quelle: Interreg Europe / EU-Kommission, 2025) Gleichzeitig ist Deutschland durch eine tiefe Datenschutztradition geprägt, die durch die DSGVO noch verstärkt wurde. Der Reflex, vor dem Einsatz von KI erst alle Rechtsfragen zu klären, ist hier stärker als anderswo.

Die Europäische Kommission schiebt unterdessen aktiv an. Der „Apply AI“-Aktionsplan vom Oktober 2025 zielt explizit auf kleine und mittelständische Unternehmen ab, weil erkannt wurde, dass die großen Konzerne bereits weitgehend investieren, während KMU zurückbleiben. Deutschland hatte bis 2025 insgesamt 5 Milliarden Euro für die Förderung von KI eingeplant, davon wurden bis Juni 2024 rund 3,38 Milliarden Euro in konkrete Projekte gelenkt. (Quelle: OECD / EU AI Watch, Germany, 2024

Die größte Gefahr ist das Schweigen

Wenn Mitarbeitende KI ohne Richtlinien nutzen, entstehen echte Risiken: unkontrollierte Datenweitergabe an externe Dienste, fehlende Nachvollziehbarkeit von Entscheidungen, rechtliche Haftungsfragen. Das ist kein Vorwurf an die Mitarbeitenden. Das ist das Ergebnis eines Vakuums. Wenn niemand Regeln macht, machen Menschen pragmatische Entscheidungen. Das ist menschlich. Und das ist genau der Grund, warum das Zögern der Entscheider am Ende teurer wird als das Handeln.

„Wenn man den Leuten keinen Zugang zu KI gibt, finden sie ihren Weg hinein, oft auf eine Art, die Richtlinien umgeht, Fehler einbringt und Verantwortlichkeit verwischt.“

Überblick: Was an den häufigsten Skepsis-Argumenten stimmt und was nicht

| Skepsis-Typ | Berechtigter Kern | Häufige Fehlannahme |

| Genauigkeitsangst | KI halluziniert wirklich, besonders bei Fachfragen | Kein System einzuführen ist sicherer als ein kontrolliertes System |

| Regulierungsangst | EU AI Act und DSGVO stellen echte Anforderungen | Inoffizielle Nutzung durch Mitarbeitende ist regulatorisch risikoärmer |

| Kontrollverlust | Haftungsfragen sind noch nicht vollständig geklärt | Ohne offizielle Einführung gibt es keine Haftungsrisiken |

| Vertrauensdefizit | Mitarbeitende haben Ängste, die ernst genommen werden sollten | Führungskräfte müssen nicht transparent kommunizieren |

| ROI-Skepsis | Viele Pilotprojekte liefern keinen messbaren Wert | Warten löst das Problem der fehlenden Messbarkeit |

Was jetzt hilft

Die Frage ist nicht: Sollen wir KI einführen? Die Frage ist: Wie holen wir die Realität ins Offizielle? Mitarbeitende nutzen KI bereits. Die Aufgabe der Führung ist, das zu gestalten, nicht zu verhindern. Was wirklich hilft, sind keine großen Transformationsprojekte von oben, sondern kleine, ehrliche Schritte: ein klar definierter Pilotbereich, echte Transparenz über Daten, eine Governance-Struktur, die mit dem Wissen wächst, und vor allem das direkte Gespräch mit denjenigen, die die Tools schon nutzen. PwC empfiehlt explizit, die Zukunft mit den Mitarbeitenden gemeinsam zu gestalten, nicht für sie zu entscheiden.

Der EU AI Act ist kein Feind der Einführung. Er ist ein Rahmen. Wer jetzt investiert, die eigene KI-Nutzung zu verstehen und zu dokumentieren, ist in zwei Jahren nicht einem Compliance-Problem ausgesetzt, sondern einem Vorsprung gegenüber den Wettbewerbern, die weiter gewartet haben. (EU AI Act, Details)

Das Zögern der Führungsetage ist kein technisches Problem. Es ist ein Vertrauens- und Orientierungsproblem. Die Lösung liegt nicht in mehr Technologie, sondern in mehr Klarheit darüber, was bereits passiert.

Ihre Mitarbeitenden nutzen KI bereits. Die Frage ist nicht ob, sondern wie strukturiert. Agentivo hilft Unternehmen, genau diese Lücke zu schließen.

Quellen

- McKinsey — Superagency in the Workplace, Januar 2025

- KPMG — Trust, Attitudes and Use of Artificial Intelligence: A Global Study 2025

- PwC — Global Workforce Hopes and Fears Survey 2025

- EY — Responsible AI Pulse Survey 2025

- Europäische Kommission — EU AI Act, Überblick und Zeitplan

- Europäische Kommission — Apply AI Strategy, Oktober 2025

- EU AI Watch — Germany AI Strategy Report

- CMS Law — 2025 in Data Protection: EU & Germany, Januar 2026

- Stanford AI Index / G2 — Global AI Adoption Statistics 2025

- Azumo — AI in the Workplace Statistics 2026

- OECD — Progress in Implementing the EU Coordinated Plan on AI: Germany, 2024

- Interreg Europe — AI and GenAI Adoption by Local and Regional Administrations, 2025

- Kate Crawford — Atlas of AI, Yale University Press, 2021