TL;DR

KI-Agenten sind 2025 der nächste große Paradigmenwechsel in der Künstlichen Intelligenz.

- Sie entwickeln sich von reaktiven Chatbots zu handelnden Systemen, die planen, Tools nutzen und Entscheidungen eigenständig anpassen.

- Kernarchitektur: Ziele + Planung, Tool-Orchestrierung, Gedächtnis & Reflexion.

- Forschungsmeilensteine wie ReAct, Reflexion, Generative Agents und Embodied Agents treiben die Entwicklung voran.

- Praxisfälle: Data Mining, Coding Agents, Backoffice-Automatisierung, Kundenservice.

- Sicherheit 2025: Prompt-Injection, Tool-Missbrauch und Memory Poisoning gehören zu den größten Risiken.

- Benchmarks: SWE-bench, UTBoost und SWE-rebench setzen neue Standards für Evaluation.

- Technologie-Stack: Frameworks wie LangGraph, AutoGen, AutoGPT und crewAI dominieren, kombiniert mit RAG, APIs und RPA-Tools.

- Ausblick: Der EU AI Act 2025 gibt den regulatorischen Rahmen vor. Wer früh investiert, sichert sich nachhaltige Vorteile in einer zunehmend agentischen Zukunft.

Warum KI-Agenten das nächste Paradigma sind

Stellen Sie sich eine KI vor, die nicht nur eine vordefinierte Pipeline verfolgt, sondern selbst Entscheidungen trifft und aktiv handelt. Genau hier setzt die aktuelle Entwicklung an: Die Welt der Künstlichen Intelligenz bewegt sich von reaktiven Systemen hin zu autonomen Akteuren, die Ziele verfolgen, Aufgaben zerlegen und mit ihrer Umgebung interagieren.

Die Geschichte der KI ist reich an Wendepunkten – von Expertensystemen in den 1980er-Jahren über maschinelles Lernen in den 2000ern bis zu tiefen neuronalen Netzen ab den 2010ern. Mit dem Aufkommen großer Sprachmodelle wie GPT-3 oder T5 wurde ein neues Kapitel in der Verarbeitung natürlicher Sprache aufgeschlagen. Doch zunehmend zeigt sich: Textgenerierung allein reicht nicht mehr aus.

Unternehmen, Forschung und Gesellschaft verlangen nach Systemen, die über reine Antworten hinausgehen – Systeme, die planen, handeln und lernen können. Diese neuen Einheiten, bekannt als KI-Agenten, markieren den Übergang von passiven Werkzeugen zu proaktiven Partnern in komplexen digitalen Ökosystemen.

Der Treiber liegt nicht nur in der Technologie – leistungsfähigere Infrastrukturen, riesige Datenmengen und Fortschritte in multimodalen Modellen – sondern auch im wirtschaftlichen und gesellschaftlichen Druck, Prozesse effizienter und widerstandsfähiger zu gestalten. Besonders in Branchen wie Finanzwesen, Logistik oder Gesundheitsversorgung zeigt sich der Bedarf an Agenten, die mit Unsicherheit umgehen, Erfahrungen einbeziehen und einen nachhaltigen Mehrwert schaffen.

So werden KI-Agenten nicht einfach als nächste Innovation betrachtet, sondern als Paradigmenwechsel: Sie stehen für die Transformation von Maschinen, die nur reagieren, zu Akteuren, die selbstständig handeln und damit unsere Beziehung zu Information, Arbeit und Technologie neu definieren.

Von starren Workflows zu handelnden Systemen:Ein tiefgreifender Wandel

Die Automatisierung in Unternehmen basierte über viele Jahre hinweg auf starren Prozessen: vordefinierte Abläufe, einfache Entscheidungslogiken auf Basis von Regeln oder schlichte RPA-Skripte. Solche Systeme können wiederkehrende Aufgaben effizient erledigen, stießen jedoch sofort an ihre Grenzen, sobald unerwartete Situationen oder höhere Komplexität ins Spiel kamen.

Mit dem Aufkommen großer Sprachmodelle und fortschrittlicher Planungsmechanismen vollzieht sich nun ein tiefgreifender Wandel. Workflows entwickeln sich zu handelnden Systemen, die nicht mehr nur starre Schritte abarbeiten, sondern Ziele flexibel verfolgen, Entscheidungen situativ anpassen und aktiv mit Werkzeugen sowie Datenquellen interagieren. Ein Kundenservice-Agent kann zum Beispiel nicht nur eine Anfrage beantworten, sondern selbstständig die passende Datenbank abfragen, ein Ticket eröffnen und den Status laufend aktualisieren. Das eröffnet ein neues Potenzial: Ganze Geschäftsprozesse können selbstständig gesteuert und optimiert werden.

Besonders deutlich zeigt sich dieser Paradigmenwechsel in Bereichen wie Customer Experience, Softwareentwicklung und Wissensmanagement, wo Systeme nicht länger lediglich auf Befehle reagieren, sondern Aufgaben eigenständig planen, priorisieren und ausführen.

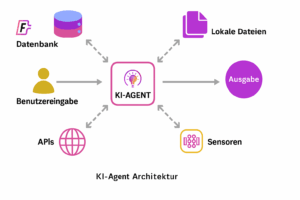

Kernarchitektur von KI-Agenten

Damit Agenten nicht nur reagieren, sondern eigenständig handeln können, benötigen sie eine klare innere Struktur. Diese Architektur sorgt dafür, dass Ziele definiert, passende Werkzeuge ausgewählt, Erfahrungen gespeichert und Handlungen kritisch bewertet werden. Drei Bausteine sind dabei besonders entscheidend:

- Ziele, Planung und Kontext

Der Ausgangspunkt eines Agenten ist immer ein Ziel. Anstatt nur auf Eingaben zu reagieren, analysiert der Agent den Kontext, zerlegt komplexe Aufgaben in Teilschritte und passt seine Planung flexibel an neue Situationen an. So wird aus einer simplen Antwortmaschine ein System, das strategisch denken und agieren kann.

- Tool-Nutzung und Orchestrierung

Um Ziele zu erreichen, nutzt ein Agent externe Werkzeuge: Datenbanken, APIs, Suchmaschinen oder Software-Module. Der eigentliche Mehrwert liegt in der Orchestrierung – der Fähigkeit, das richtige Tool zum richtigen Zeitpunkt einzusetzen, Abläufe zu koordinieren und Ergebnisse auf Zielerreichung zu prüfen. - Gedächtnis und Reflexion

Agenten speichern Erfahrungen und bauen darauf auf. Kurzzeitgedächtnis hält aktuelle Informationen bereit, während Langzeitgedächtnis Wissen und Strategien sichert. Mit Reflexion können Agenten ihr eigenes Handeln bewerten, Fehler erkennen und daraus lernen – ein Mechanismus, der zu kontinuierlicher Verbesserung führt.

Forschungsmeilensteine

Die Entwicklung von KI-Agenten ruht nicht nur auf Theorien, sondern wird stetig durch neue Forschungsarbeiten weiterentwickelt. Vier zentrale Ansätze stehen heute besonders im Fokus:

- ReAct (Reason + Act)

Der Ansatz, Denken und Handeln systematisch zu kombinieren, bleibt zentral. Aktuelle Studien zeigen, dass Agenten, die ihre Planungsschritte verbal ausformulieren und dann Aktionen ausführen, robuster gegenüber unvorhergesehenen Situationen sind.

Es wird diskutiert, wie man solche ReAct-Mechanismen effizient in Multi-Agenten-Systeme integrieren kann, sodass Agenten sowohl eigenständig agieren als auch kooperieren.

- Reflexion (Selbst-Feedback als Lernsignal)

In neueren Arbeiten verwendet man Sprachmodell-basierte Reflexion nicht nur zur Fehleranalyse, sondern zur kontinuierlichen Anpassung des Plans. Systeme speichern Reflexionsnotizen, vergleichen sie mit vergangenen Ergebnissen und leiten daraus neue Strategien ab.

In Experimenten mit mehrstufigen Aufgaben konnte gezeigt werden, dass reflexive Agenten schneller zu besseren Lösungen kommen, ohne auf externes Fine-Tuning zurückzugreifen.

- Generative Agents (Gedächtnis + Planung)

Agenten mit strukturiertem Gedächtnis nutzen Wissen aus der Vergangenheit, um künftige Aktionen zu planen. Aktuelle Forschungsartikel aus 2025 zeigen, dass Gedächtnisstrukturen (z. B. Vektorenspeicher, episodische Logs) und Planungsmechanismen gekoppelt werden, um langfristige Konsistenz und Anpassungsfähigkeit zu gewährleisten.

Besonders wichtig ist die Balance zwischen Exploration (Neues lernen) und Exploitation (auf bekanntem Wissen aufbauen). Neuere Systeme implementieren Strategien, um diese Balance adaptiv zu steuern.

- Embodied Agents

In 2025 wurden mehrere Arbeiten veröffentlicht, die „verkörperte Agenten“ weiterentwickeln, also Agenten, die in visuellen, virtuellen oder physischen Umgebungen agieren und lernen. Zum Beispiel:- Die Studie „Embodied AI Agents: Modeling the World“ (Juni 2025) entwickelt Ansätze, wie Agenten ihre Umgebung durch multimodale Wahrnehmung modellieren, um bessere Schlussfolgerungen und Planungen zu ermöglichen.

- In „Generative AI in Embodied Systems: System-Level Analysis of Performance, Efficiency and Scalability“ (April 2025) wird systematisch untersucht, welche Herausforderungen bei realen Anwendungen bestehen — etwa Latenz, Gedächtnisintegrität und Skalierbarkeit.

- Ein konkretes Roboter-System: LLM-Empowered Embodied Agent for Memory-Augmented Task Planning (April 2025) zeigt, wie ein Agent in Haushaltsumgebungen mit Gedächtnis und Planung Objekte verwalten kann.

- Außerdem existieren neue Benchmarks wie OmniEAR (August 2025), die die Fähigkeit von Agenten testen, in verkörperten Aufgaben zu reasoning und Tool-Einsatz zu kombinieren.

Diese Forschung deutet darauf hin, dass verkörperte Agenten nicht länger bloße Vision sind, sondern zunehmend realisierbar werden ,mit starker Integration von Wahrnehmung, Gedächtnis, Planung und Handlung.

Wichtige Anwendungsfälle in der Praxis

Kaum eine Technologie bleibt abstrakt, wenn sie echten Nutzen zeigt. Genau hier werden KI-Agenten spannend: Sie verlassen die Forschungswelt und tauchen in den Alltag von Unternehmen ein. Ob Datenanalyse, Softwareentwicklung oder Kundenservice – überall dort, wo Prozesse komplex und dynamisch sind, eröffnen sie neue Möglichkeiten. Vier Einsatzfelder stechen aktuell besonders hervor:

- Forschung & Data Mining

Agenten können große Datenmengen durchforsten, relevante Informationen extrahieren und Ergebnisse strukturieren. Sie arbeiten rund um die Uhr, erkennen Muster und liefern präzise Reports, die Forschern und Analysten Zeit sparen und fundiertere Entscheidungen ermöglichen.

- Softwareentwicklung & Coding Agents

In der Entwicklung unterstützen Agenten bei Code-Generierung, Fehleranalyse oder automatischem Testing. Neuere Benchmarks wie SWE-bench zeigen, dass coding agents in der Lage sind, reale Software-Issues selbstständig zu lösen. Damit werden Entwicklerteams entlastet und Entwicklungszyklen verkürzt.

- Operations & Backoffice-Automatisierung

Ob Rechnungsverarbeitung, Terminverwaltung oder Reporting – KI-Agenten übernehmen Routineaufgaben, die bislang menschliche Aufmerksamkeit erforderten. Durch den Zugriff auf interne Tools und Systeme können sie administrative Prozesse effizienter gestalten und Fehlerquoten deutlich reduzieren. - Kundenservice & digitale Copiloten

Im Kundenkontakt werden Agenten als smarte Assistenten eingesetzt. Sie beantworten Anfragen, bearbeiten Bestellungen und eskalieren komplexe Fälle gezielt an menschliche Mitarbeiter. Damit entsteht eine neue Form von digitalem Copilot, der Servicequalität verbessert und gleichzeitig Kosten senkt.

Sicherheitsaspekte und Risiken

Mit der neuen Generation von KI-Agenten eröffnen sich nicht nur Chancen, sondern auch völlig neue Angriffsflächen. Forschung und Industrieberichte aus dem Jahr 2025 zeigen klar: Agenten sind anfällig für Manipulationen, die weit über klassische IT-Risiken hinausgehen. Drei Themen dominieren die Diskussion: Prompt-Injektionen, Tool-Missbrauch und Gedächtnis-Manipulation.

- Prompt-Injection als Kernrisiko

Studien wie AgentXploit (Mai 2025) und WASP (April 2025) belegen, dass selbst modernste Web- und Task-Agenten durch gezielt eingeschleuste Eingaben kontrolliert werden können. In Benchmarks gelang es Forschern, Agenten bereits mit wenigen Interaktionen dazu zu bringen, Richtlinien zu umgehen oder unerwünschte Aktionen auszuführen. Google hat im Juni 2025 eigene Schutzstrategien vorgestellt, die auf einer „Layered Defense“ basieren, um solche Angriffe abzufangen. - Tool-Missbrauch & Code-Execution

Sobald Agenten Zugriff auf externe Schnittstellen haben, steigt das Risiko für Missbrauch. Trend Micro dokumentierte im Jahr 2025, wie Angreifer über manipulierte Eingaben bösartigen Code einschleusen konnten. In realistischen Szenarien führten Agenten dadurch unautorisierte Programme aus oder griffen auf Daten zu, die eigentlich geschützt sein sollten. Microsoft stellte im Juli 2025 das Framework FIDES vor, das den Informationsfluss strikt kontrolliert und damit Angriffe durch indirekte Prompt Injection eindämmt.

- Visuelle & Gedächtnis-Manipulation

Neue Forschungsarbeiten wie VPI-Bench (Juni 2025) zeigen, dass Angriffe auch über visuelle Oberflächen möglich sind. Versteckte Instruktionen in Benutzeroberflächen können Agenten unbemerkt in die Irre führen. Hinzu kommt das Risiko des Memory Poisoning: Werden falsche Informationen ins Gedächtnis eines Agenten eingespeist, können diese langfristig die Entscheidungsfindung verzerren und ganze Prozessketten gefährden.

Evaluation und Benchmarks

Eine belastbare Bewertung von KI-Agenten braucht zwei Dinge: klare Metriken und realitätsnahe Benchmarks. 2025 sind folgende Ansätze in Forschung und Praxis maßgeblich.

- Metriken zur Erfolgsbewertung

In aktuellen Übersichtsarbeiten wird empfohlen, Agenten entlang mehrerer Dimensionen zu messen – nicht nur das Endergebnis, sondern auch den Prozess:

Task-Completion-Rate, Tool-Korrektheit, Zeit/Kosten pro Aufgabe, Retry-Rate, Fehlertypen (z. B. Planungs- vs. Tool-Fehler) sowie Sicherheits- und Robustheit Metriken für agentische Szenarien. 2025-Surveys strukturieren diese Evals ausdrücklich für LLM-basierte Agenten und unterscheiden Ziel- und Prozess-getriebene Bewertungen.

- SWE-bench und andere Referenztests

SWE-bench (Verified/Lite/Multimodal) bleibt der wichtigste, praxisnahe Maßstab für Coding-Agenten: echte GitHub-Issues, PR-Erstellung und Tests. 2025 meldet Anthropic für Claude 3.5 Sonnet 49 % auf SWE-bench Verified (Januar 2025).

Gleichzeitig zeigen neue Arbeiten, dass die Testabdeckung von SWE-bench punktuell zu lax war. UTBoost (Juni 2025) ergänzt/verschärft Testfälle und berichtet 24,4 % Korrekturen in SWE-bench Verified (und 40,9 % in Lite) – mit spürbaren Ranglisten-Verschiebungen.

Um Evaluierungen aktuell und kontaminationsfrei zu halten, wurde SWE-rebench (Mai 2025) vorgestellt: ein kontinuierlich erneuerter Aufgabensatz (21 000+ Tasks) samt öffentlicher Leaderboards.

Für Tool-/Agent-Fähigkeiten jenseits von Coding erscheint 2025 zudem MCPToolBench++, ein großskaliger Benchmark zur Werkzeugnutzung über das Model Context Protocol (MCP) in vielen Domänen.

Technologie-Stack 2025

Der Erfolg von KI-Agenten hängt nicht nur von guten Modellen ab – entscheidend ist auch, welcher Technologie-Stack sie verbindet. Im Jahr 2025 kristallisieren sich bestimmte Frameworks, Tools und Integrationen heraus, die in der Praxis bereits erfolgreich eingesetzt werden.

- LangGraph

Ein Open-Source-Framework von LangChain (mit großen Updates 2025), das auf Graph-basierte Orchestrierung spezialisiert ist. Komplexe Workflows lassen sich als gerichtete Graphen modellieren, wodurch klar erkennbar wird, welcher Agent welche Aufgabe übernimmt. Besonders geschätzt wird die Transparenz und Nachvollziehbarkeit bei Multi-Agent-Systemen. - AutoGen (Microsoft Research)

AutoGen setzt auf Multi-Agenten-Dialoge, bei denen mehrere spezialisierte Agenten in Rollen wie „Coder“ oder „Reviewer“ zusammenarbeiten. Dadurch lassen sich kollaborative Szenarien abbilden, die an echte Teams erinnern. 2025 findet AutoGen vor allem Anwendung in der Softwareentwicklung und Forschung. - AutoGPT

Eines der ersten Experimente (2023) für autonome LLM-Agenten, das 2025 weiterhin beliebt ist für Prototyping und Bildung. Dank einer aktiven Community und vielen Plugins können Entwickler schnell Funktionen wie Websuche, API-Zugriff oder Dateiverarbeitung einbinden, um Ideen zu testen. - crewAI

Ein junges Framework (seit 2024), das Agenten als Teams mit Rollenverteilung modelliert. Typisch sind Setups mit einem „Researcher“, „Writer“ oder „Strategist“. 2025 gewinnt crewAI an Popularität, weil es Kollaboration und Koordination vereinfacht und so besonders für Startups interessant ist.

Tooling und Integrationen

KI-Agenten entfalten ihr Potenzial erst dann vollständig, wenn sie sich mit externen Werkzeugen und Datenquellen verbinden. 2025 gilt es als Standard, dass Agenten nicht nur Sprache generieren, sondern aktiv mit APIs, Datenbanken und Anwendungen interagieren.

- Retrieval-Augmented Generation (RAG)

RAG ist inzwischen ein Grundbaustein fast aller Agentensysteme. Agenten nutzen Vektordatenbanken (z. B. Pinecone, Weaviate, FAISS), um Dokumente zu durchsuchen und Antworten mit externem Wissen anzureichern. Damit lassen sich Halluzinationen reduzieren und Fachwissen dynamisch einbinden. - APIs und Datenbanken

Agenten werden zunehmend in Unternehmenssoftware integriert: CRM-Systeme, ERP-Plattformen oder Cloud-Datenbanken. Über standardisierte Schnittstellen wie REST, GraphQL oder SQL können sie Daten abrufen, analysieren und verändern. - Automatisierung & RPA

Durch die Kopplung mit RPA-Tools (z. B. UiPath, Automation Anywhere) oder Low-Code-Plattformen können Agenten repetitive Geschäftsprozesse automatisieren. 2025 ist die Kombination von RPA und LLM-Agentik ein zentraler Trend in Backoffice- und Finance-Anwendungen. - Browser- und Code-Ausführung

Viele Agenten erhalten die Fähigkeit, eigenständig im Web zu recherchieren oder Code auszuführen. Frameworks wie LangGraph oder AutoGen bieten native Module für Browser-Steuerung und Python-Runner, die Ergebnisse in Echtzeit zurückspielen. - Monitoring und Observability

Damit Agenten verlässlich eingesetzt werden können, setzen Unternehmen auf Observability-Pakete: Tracking von Kosten, Tool-Nutzung, Fehlerraten und Sicherheitslogs. Lösungen wie Weights & Biases, LangSmith oder OpenTelemetry helfen, Agentenprozesse transparent zu überwachen.

Häufige Fragen (FAQ)

Was unterscheidet einen KI-Agenten von einem klassischen Chatbot?

Ein Chatbot reagiert auf vordefinierte Eingaben, während ein AI-Agent eigenständig Ziele verfolgt, Tools nutzt und Entscheidungen anpasst.

Welche Anwendungsfälle sind 2025 am wichtigsten?

Besonders verbreitet sind Forschung & Data Mining, Coding Agents, Backoffice-Automatisierung und Kundenservice mit digitalen Copiloten.

Wie sicher sind KI-Agenten in der Praxis?

2025 gilt Sicherheit als große Herausforderung. Prompt-Injection, Tool-Missbrauch und Gedächtnis-Manipulation gehören zu den größten Risiken – Unternehmen setzen deshalb auf mehrstufige Schutzmaßnahmen.

Welche Frameworks sollte man heute kennen?

LangGraph, AutoGen, AutoGPT und crewAI sind 2025 die meistgenutzten Frameworks für Aufbau und Orchestrierung von Agenten.

Können KI-Agenten menschliche Arbeit komplett ersetzen?

Nein. Agenten können Prozesse beschleunigen und Aufgaben übernehmen, doch menschliche Kontrolle, Kreativität und Verantwortung bleiben unverzichtbar.

Welche Rolle spielt Regulierung und der EU AI Act 2025?

Der europäische AI Act 2025 schafft verbindliche Standards für den Einsatz von Agenten. Besonders relevant sind Anforderungen an Transparenz, Risikobewertung und menschliche Aufsicht, die für Unternehmen verpflichtend werden.

Fazit und Ausblick

KI-Agenten markieren 2025 den Übergang von reiner Automatisierung zu handelnden, adaptiven Systemen. Sie verändern, wie Unternehmen forschen, entwickeln, Kunden betreuen und Prozesse steuern. Gleichzeitig stellen Sicherheit, Transparenz und Regulierung entscheidende Baustellen dar.

Der Ausblick: In den kommenden Jahren werden KI-Agenten tiefer in Geschäftsprozesse integriert, mit klareren Standards, besserer Observability und stärkerer Governance. Besonders der EU AI Act 2025 wird den Rahmen setzen, wie Agenten in Europa verantwortungsvoll eingesetzt werden – ein entscheidender Faktor für Vertrauen und Wettbewerbsfähigkeit.

Wer heute investiert, legt den Grundstein für nachhaltige Wettbewerbsfähigkeit in einer zunehmend agentischen Zukunft.

Genau hier setzt Agentivo.ai an: unsere Plattform ermöglicht es Unternehmen, KI-Agenten sicher, flexibel und praxisnah einzusetzen. Erfahren Sie mehr auf unserer Website oder treten Sie direkt über unser Kontaktformular mit uns in Verbindung.