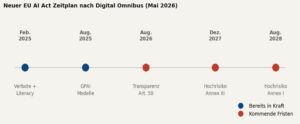

Am 7. Mai 2026 einigten sich Rat und Parlament auf eine Verschiebung der Hochrisiko-Fristen. Aus August 2026 wurde Dezember 2027. Wer glaubt, das sei ein Aufschub, hat das Gesetz nicht verstanden.

| TL;DR

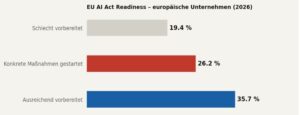

Der Digital Omnibus vom 7. Mai 2026 verschiebt die Hochrisiko-Pflichten für eigenständige KI-Systeme (Annex III) auf den 2. Dezember 2027 und für KI in regulierten Produkten (Annex I) auf den 2. August 2028. Das klingt nach Erleichterung. Es ist keines. Laut Vision Compliance haben 78 Prozent der europäischen Unternehmen noch keine ernsthaften Schritte unternommen. Und laut Deloitte haben erst 26,2 Prozent konkrete Compliance-Maßnahmen gestartet. Die neuen Fristen sind fix. Es gibt keinen glaubwürdigen politischen Weg zu einer dritten Verschiebung. Was sofort gilt: Transparenzpflichten nach Artikel 50 für neue KI-Systeme bleiben am 2. August 2026 wirksam. Watermarking für bereits auf dem Markt befindliche generative Systeme gilt ab dem 2. Dezember 2026. |

Ein Aufschub, der keiner ist.

Stellen Sie sich vor, Sie führen ein mittelständisches Unternehmen in Bayern mit 300 Mitarbeitenden. Ihr HR-Team setzt seit zwei Jahren ein Tool zur Bewerbervorselektion ein. Ihr Vertrieb nutzt ein CRM-Modul, das Kundenbonität automatisch bewertet. Und Ihr Kundensupport läuft über einen Chatbot. Alle drei sind Hochrisiko-Systeme im Sinne des EU AI Act. Bis Dezember 2027 haben Sie jetzt mehr Zeit. Aber wenn Sie heute noch nicht wissen, dass diese Systeme reguliert werden, dann ist Dezember 2027 genauso nah wie August 2026 sich angefühlt hat, als man zum ersten Mal davon hörte.

Das ist der Kern des Problems. Vision Compliance hat im April 2026 Unternehmen aus acht Sektoren bewertet und festgestellt: 78 Prozent haben noch keine ernsthaften Schritte unternommen. Deloitte befragt 500 Führungskräfte und kommt zum gleichen Befund: Erst 26,2 Prozent haben konkrete Maßnahmen eingeleitet. Diese Zahlen waren unter dem alten Zeitplan besorgniserregend. Unter dem neuen sind sie ein strukturelles Risiko, das sich auf 18 Monate verschoben hat, nicht aufgelöst.

Was sich verändert hat. Und was nicht.

Am 7. Mai 2026 einigten sich Rat und Parlament auf den Digital Omnibus on AI. Die politische Einigung, die noch formal angenommen werden muss, verschiebt die Hochrisiko-Pflichten erheblich. Die ursprüngliche Frist vom 2. August 2026 für eigenständige Systeme nach Annex III gilt nicht mehr. Stattdessen gelten zwei neue Fristen mit fixen Terminen.

Eigenständige Hochrisiko-Systeme nach Annex III, darunter Personalauswahltools, Kreditscoring-Systeme, biometrische Identifikation und kritische Infrastruktur, müssen ab dem 2. Dezember 2027 compliant sein. KI-Systeme, die in regulierte Produkte eingebettet sind, etwa Medizingeräte, Maschinen oder Aufzüge, haben eine verlängerte Frist bis zum 2. August 2028. Laut Bird & Bird sind diese Termine politisch fixiert. Eine dritte Verschiebung ist nicht denkbar.

| Was ab dem 2. August 2026 unverändert gilt

Die Transparenzpflichten nach Artikel 50 für neue KI-Systeme bleiben aktiv. Watermarking und maschinell lesbare Kennzeichnung für generative KI-Systeme, die bereits auf dem Markt sind, gilt ab dem 2. Dezember 2026. Die Verbote nach Artikel 5, AI Literacy nach Artikel 4 und die GPAI-Pflichten laufen wie geplant. Was verschoben wurde, sind ausschließlich die Hochrisiko-Anforderungen. |

Warum die Verschiebung keine Pause rechtfertigt.

Travers Smith fasst es klar zusammen: Das politische Argument für eine Verschiebung wurde einmal verwendet. Die Institutionen haben deutlich signalisiert, dass es kein zweites Mal verwendet werden wird. Der Grund für die erste Verschiebung war, dass harmonisierte Standards und Konformitätsbewertungsinfrastruktur nicht rechtzeitig vorlagen. Die neuen Fristen von 2027 und 2028 wurden explizit so gewählt, um diesen Rückstand aufzuholen. Dieses Argument kann kein zweites Mal gebracht werden.

Vier konkrete Gründe für die Verzögerung

Die Verschiebung ist kein Zufall, sie hat strukturelle Ursachen, die im Dokument benannt werden sollten:

- Bis zur August-2025-Frist hatten nur 8 von 27 Mitgliedstaaten zuständige nationale Behörden designiert, die institutionelle Infrastruktur fehlte flächendeckend.

- Die harmonisierten CEN/CENELEC-Standards wurden nicht rechtzeitig fertiggestellt. Die Kommission registrierte „erhebliche Verzögerungen“ offiziell im Durchführungsbeschluss vom 23. Juni 2025.

- Die Kommission hat ihre eigene gesetzliche Frist vom 2. Februar 2026 versäumt: Die Leitlinien zur Klassifizierung von Hochrisiko-Systemen wurden nicht fristgerecht veröffentlicht.

- Politischer Druck von oben: Bundeskanzler Merz lobbierte persönlich bei anderen Mitgliedstaaten und der Kommission für eine Verschiebung, ein seltenes Signal, dass der wirtschaftliche Druck auf Regierungsebene angekommen war.

Unternehmen, die heute mit dem Aufbau von Governance beginnen, haben im Dezember 2027 einen strukturellen Vorteil, nicht nur gegenüber Behörden, sondern gegenüber Wettbewerbern. Secure Privacy stellt fest, dass über die Hälfte der Unternehmen noch nicht einmal ein vollständiges Inventar ihrer KI-Systeme hat. Ohne dieses Inventar ist keine Klassifizierung möglich, ohne Klassifizierung keine Compliance, und ohne Compliance keine rechtssichere KI-Strategie.

| Die Verschiebung hat die Fristen verändert. Die Anforderungen selbst sind unberührt geblieben. |

Was Unternehmen jetzt konkret schulden.

Trotz der verschobenen Hochrisiko-Fristen gibt es laufende Pflichten, die bereits gelten oder in den nächsten Monaten greifen. Wer diese ignoriert, steht nicht erst 2027 vor einem Problem.

| Verstoß | Max. Bußgeld | Wer betroffen |

| Verbotene KI: Social Scoring, Manipulation, biometrische Massenüberwachung | 35 Mio. EUR oder 7 % Jahresumsatz | Anbieter und Betreiber |

| Hochrisiko-Verstoß: fehlende Dokumentation, unzureichende Aufsicht | 15 Mio. EUR oder 3 % Jahresumsatz | Anbieter und Deployer |

| Irreführende Angaben gegenüber Aufsichtsbehörden | 7,5 Mio. EUR oder 1,5 % Jahresumsatz | Alle Akteure |

SQ Magazine schätzt die Compliance-Kosten für ein einzelnes Hochrisiko-System auf rund 52.000 Euro jährlich. Wer diese Kosten frühzeitig in die Planung integriert, zahlt deutlich weniger als wer nachträglich nachrüsten muss. Fehlklassifizierte Systeme erhöhen den Aufwand laut Studien um 20 bis 40 Prozent.

Fünf strukturelle Gründe für die Lücke.

78 Prozent Unvorbereitetheit ist keine Gleichgültigkeit. Es sind strukturelle Hindernisse, die sich auch mit mehr Zeit nicht von selbst lösen.

| 01 | Die Risikoklassifizierung ist schwieriger als gedacht

Die Europäische Kommission schätzte ursprünglich, dass nur 5 bis 15 Prozent der KI-Systeme unter die Hochrisiko-Kategorie fallen. Eine Studie von appliedAI über 106 Unternehmenssysteme fand: 18 Prozent eindeutig Hochrisiko, 40 Prozent unklar klassifizierbar. Wer seine Systeme nicht kennt, kann sie nicht klassifizieren. |

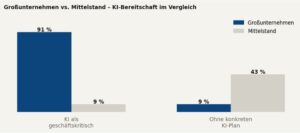

| 02 | Der Mittelstand hat strukturelle Kapazitätsgrenzen

43 Prozent der deutschen Mittelstandsunternehmen haben keinen konkreten KI-Plan. Horvath belegt, dass der Mittelstand seine KI-Investitionen 2025 auf 0,35 Prozent des Umsatzes gesenkt hat, während der Marktschnitt 0,5 Prozent beträgt. |

| 03 | Fehlende KI-Inventare als Ausgangsproblem

Secure Privacy stellt fest, dass über die Hälfte der Organisationen kein systematisches Inventar ihrer KI-Systeme hat. Kein Inventar bedeutet: keine Klassifizierung, keine Dokumentation, keine Governance. |

| 04 | AI Literacy gilt seit 15 Monaten und wird ignoriert

Artikel 4 ist seit Februar 2025 durchsetzbar. Er verpflichtet Unternehmen, sicherzustellen, dass alle Mitarbeitenden, die KI einsetzen, ausreichende Grundkenntnisse haben. Neueda stellt fest, dass die meisten Unternehmen diese Pflicht als reines HR-Thema behandeln. |

| 05 | Compliance wird als Einmalprojekt missverstanden

Sprinto bringt es auf den Punkt: Der EU AI Act hat keine Ziellinie. Die Kommission veröffentlicht laufend Leitlinien und delegierte Rechtsakte. Jede wesentliche Änderung eines KI-Systems kann eine neue Konformitätspflicht auslösen. Compliance-Programme, die als statische Dokumente aufgebaut werden, veralten schneller als die meisten Teams realisieren. |

Was Dezember 2027 realistisch bedeutet.

18 Monate sind knapp für Unternehmen, die noch kein KI-Inventar haben. Wer heute mit der Bestandsaufnahme beginnt, hat bis Dezember 2027 genug Zeit für eine vollständige Compliance-Struktur. Wer wartet, nicht. Die Erfahrung mit GDPR zeigt: Behörden beginnen zu prüfen, sobald die Frist abläuft. Und die Bundesnetzagentur ist die zuständige Aufsichtsbehörde in Deutschland, die den Auftrag hat, die Bußgelder des EU AI Act durchzusetzen.

Der erste Schritt ist kein großes Projekt. Er ist eine Frage: Welche KI-Systeme setzen wir ein, und wer hat sie als solche identifiziert? Die Antwort auf diese Frage ist die Grundlage für alles, was danach kommt.

| Die neuen Daten sind fix. Es gibt keinen glaubwürdigen politischen Weg zu einer dritten Verschiebung. Die Uhr läuft wieder. |

Welche Sektoren am meisten betroffen sind. Und wie weit sie sind.

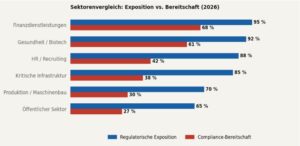

Nicht alle Unternehmen stehen vor denselben Anforderungen. Der EU AI Act folgt einem risikobasierten Ansatz, und das bedeutet in der Praxis: Die Exposition ist je nach Branche extrem unterschiedlich. Axis Intelligence hat die sektorspezifischen Implikationen detailliert analysiert. Das Ergebnis zeigt zwei dominante Muster: Sektoren mit hoher Exposition, die gleichzeitig am weitesten vorbereitet sind, und Sektoren mit hoher Exposition, bei denen die Lücke am größten ist.

Finanzdienstleistungen sind regulatorisch am stärksten exponiert. KI-Systeme im Kreditscoring, in der Risikobeurteilung und im algorithmischen Handel fallen fast ausnahmslos unter Hochrisiko-Klassifikationen. Gleichzeitig ist die Branche vergleichsweise am besten vorbereitet, da Banken und Versicherer bereits unter DSGVO, MiFID II und den Leitlinien der Europäischen Bankenbehörde (EBA) Compliance-Strukturen aufgebaut haben, die sich auf den AI Act ausdehnen lassen.

Gesundheit und Biotech stehen vor einer Doppelbelastung: Sekurno beschreibt, wie diagnostische KI-Systeme, klinische Entscheidungssupporttools und Operationsroboter gleichzeitig der Medizinprodukteverordnung (MDR) und dem EU AI Act unterliegen. Das erhöht den Aufwand, aber auch die Compliance-Reife. Unternehmen in diesem Sektor sind es gewohnt, regulierte Produkte auf den Markt zu bringen.

HR und Recruiting ist die Kategorie mit der größten Lücke zwischen Exposition und Bereitschaft. Tools zur Bewerbervorselektion sind explizit in Annex III als Hochrisikosysteme aufgelistet, aber Knime stellt fest, dass viele Unternehmen diese Systeme noch immer als Standard-HR-Software behandeln und nie formell als KI klassifiziert haben. Die informelle Nutzung von ChatGPT und ähnlichen Tools in Einstellungsprozessen schafft zusätzliche Compliance-Risiken, die kaum jemand adressiert hat.

Produktion und Maschinenbau sind strukturell benachteiligt. KI-Systeme, die in Maschinen eingebettet sind, fallen unter Annex I und hatten ursprünglich die längste Übergangsfrist bis August 2028. Das hat dazu geführt, dass der Sektor am wenigsten vorbereitet ist, obwohl die Anforderungen komplex sind und erhebliche Vorlaufzeiten für Konformitätsbewertungen benötigt werden.

Welche EU-Länder vorne liegen. Und warum Deutschland aufgeholt hat.

Die EU-Verordnung gilt direkt in allen 27 Mitgliedstaaten. Aber die nationale Umsetzung, also die Designation von Aufsichtsbehörden, der Aufbau von Sandboxes und die Bereitstellung von Compliance-Unterstützung für Unternehmen, variiert erheblich. Technology’s Legal Edge hat den Implementierungsstand in den wichtigsten Mitgliedstaaten analysiert.

Irland ist aktuell am weitesten. Das Land hat bereits 15 zuständige Behörden designiert, die verschiedene Sektoren abdecken, von Finanzen über Gesundheit bis Telekommunikation. Die Gesetzgebung für ein nationales KI-Büro (Oifig Náisiúnta na hIntleachta Saorga) läuft durch den legislativen Prozess und soll bis August 2026 operativ sein. Irland profitiert von seiner Rolle als europäischer Hauptsitz für große Technologieunternehmen, die Compliance früh als strategische Priorität behandeln mussten.

Spanien ist der strukturelle Vorreiter. Es ist das einzige Land, das eine dedizierte KI-Aufsichtsbehörde, die AESIA (Agencia Española de Supervisión de Inteligencia Artificial), bereits operativ hat. Spanien führt außerdem das erste nationale Regulatory-Sandbox-Programm durch und begleitet bereits zwölf Anbieter von Hochrisiko-KI-Systemen aktiv durch den Compliance-Prozess.

Frankreich verfolgt einen bildungsorientierten Ansatz. Die DGE (Direction Générale des Entreprises) priorisiert Aufklärung gegenüber Sanktionen und arbeitet aktiv mit Branchenverbänden zusammen. Das DGCCRF übernimmt die Koordinationsrolle als Single Point of Contact. Gleichzeitig bündeln PEReN und ANSSI technische KI- und Cybersecurity-Expertise für die Aufsichtsbehörden.

Deutschland liegt im Mittelfeld. Die Bundesnetzagentur ist als Hauptaufsichtsbehörde designiert, aber die föderale Struktur verkompliziert die Koordination. Hinzu kommt, dass der Mittelstand strukturell unterversorgt ist: keine dedizierten Compliance-Teams, keine AI-Governance-Rollen, und KI-Investitionen, die 2025 unter den europäischen Marktschnitt gefallen sind.

Die V4-Staaten, also Tschechien, Polen, Ungarn und die Slowakei, liegen am weitesten zurück. Die nationale Umsetzung der Behördenstruktur ist in diesen Ländern noch nicht abgeschlossen, und Digital Applied weist darauf hin, dass Unternehmen in dieser Region eine zusätzliche Komplexitätsebene haben: Sie wissen noch nicht genau, welche Behörde sie beaufsichtigen wird.

Hinweis: Bereitschafts-Score basiert auf Designierung nationaler Behörden, aktivem Sandbox-Betrieb und verfügbarer Compliance-Unterstützung für Unternehmen. Quellen: Technology’s Legal Edge (Nov. 2025), Digital Applied (Feb. 2026). — Methodologischer Hinweis: Die Sektor- und Ländergrafiken in diesem Bericht (Abschnitte „Welche Sektoren“ und „Welche EU-Länder“) sind komposite Schätzungen, die auf qualitativen Quellen synthetisiert wurden. Sie sind keine direkten Messwerte aus einer einzelnen Studie und sollten als illustrative Einordnung — nicht als empirische Präzisionsdaten — interpretiert werden.

Wir übernehmen alle Schritte, die der EU AI Act verlangt.

Bei agentivo beginnen wir damit, alle KI-Systeme im Unternehmen zu erfassen und zu klassifizieren, auch die, die intern nie als KI bezeichnet wurden. Darauf aufbauend erstellen wir die gesamte Compliance-Struktur: Dokumentation, Risikobewertung, Aufsichtsprozesse und Schulungsnachweise. Das Ergebnis ist keine abgeheftete Ordnerstruktur für den Auditor, sondern eine funktionierende Governance-Infrastruktur, auf der sich jede weitere KI-Investition sicher aufbauen lässt.

Quellen

Vision Compliance / EIN Presswire (April 2026): natlawreview.com/press-releases/vision-compliance-releases-2026-eu-ai-act-readiness-report-finds-78

Deloitte / Truescreen (März 2026): truescreen.io/articles/eu-ai-act-transparency-obligations-businesses/

EU-Kommission, AI Act (Mai 2026): digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

EU-Rat, Digital Omnibus Pressemitteilung (7. Mai 2026): www.consilium.europa.eu/en/press/press-releases/2026/05/07/artificial-intelligence-council-and-parliament-agree-to-simplify-and-streamline-rules/

Bird & Bird, Omnibus Trilogue (Mai 2026): www.twobirds.com/en/insights/2026/digital-omnibus-on-ai-provisional-agreement-reached-at-the-may-trilogue

Travers Smith (Mai 2026): www.traverssmith.com/knowledge/knowledge-container/eu-agrees-to-delay-key-ai-act-compliance-deadlines/

Modulos AI, Omnibus Deal (Mai 2026): www.modulos.ai/blog/eu-ai-act-omnibus-deal/

SQ Magazine, Compliance Costs (April 2026): sqmagazine.co.uk/eu-ai-act-compliance-cost-statistics/

Secure Privacy, AI Act 2026 (Mai 2026): secureprivacy.ai/blog/eu-ai-act-2026-compliance

Sprinto, Compliance Checklist (Mai 2026): sprinto.com/blog/eu-ai-act-compliance-checklist/

KPMG / Bebensee IT, Mittelstand (März 2026): bebensee.it/en/blog/ai-in-the-german-mittelstand-strategy-gap-facts-and-a-framework-for-action/

TwinLadder / Horvath (Feb. 2026): www.twinladder.ai/en/research/german-mittelstand-94-percent

Neueda, Workforce Readiness (April 2026): neueda.com/insights/eu-ai-act-workforce-readiness-2026/

Technology’s Legal Edge, EU Member States (Nov. 2025): www.technologyslegaledge.com/2025/11/state-of-the-act-eu-ai-act-implementation-in-key-member-states/

Axis Intelligence, Sectorenanalyse (2026): axis-intelligence.com/eu-ai-act-news-2026/

Sekurno, Healthcare AI Act (2025): www.sekurno.com/post/the-eu-ai-act-navigating-compliance-for-high-risk-businesses

Knime, Enterprise Compliance (Mai 2026): www.knime.com/blog/eu-ai-act-what-enterprises-need-do-august-2026

Digital Applied, EU Businesses Guide (Feb. 2026): www.digitalapplied.com/blog/eu-ai-act-2026-compliance-european-business-guide